OpenClaw配置优云智算AI大模型图文详细教程

优云智算 Coding Plan 大模型套餐目前6.9元/月,性价比不错。现在注册优云智算送5元赠金,抵扣后 Coding Plan 首月只要1.9元。本文以图文方式详细介绍OpenClaw配置优云智算大模型的方法和过程。

如果你还没有安装OpenClaw,可以参考:OpenClaw安装配置教程

执行OpenClaw大模型配置命令:

openclaw configure --section model

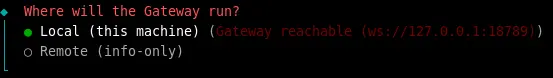

选择网关,一般默认Local,除非你配置了远程网关:

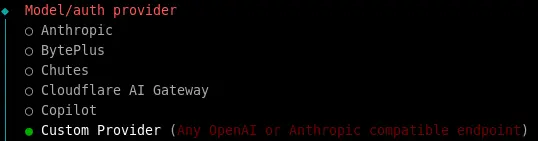

选择自定义厂商:

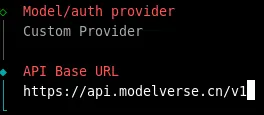

输入API Base URL:

https://api.modelverse.cn/v1

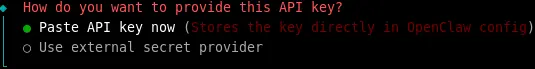

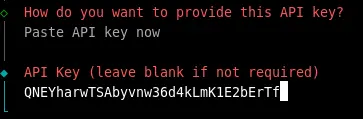

选择粘贴 API Key:

如上图所示,优云智算支持为每个API Key设置每日、每月消费额度,这个设计蛮人性化的。

粘贴API Key:

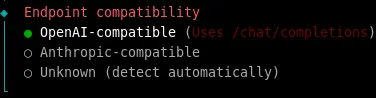

兼容接口选择:

使用MiniMax、Kimi、GLM等模型选择OpenAI-compatible,使用Claude模型选择Anthropic-compatible。如果不清楚要使用的模型兼容哪个接口,可以选择Unknown自动识别。

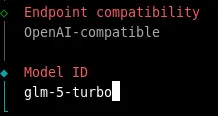

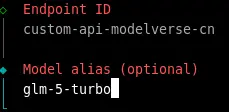

在模型广场获取模型ID,例如:glm-5-turbo

粘贴模型ID(只能设置一个,可在openclaw.json中添加):

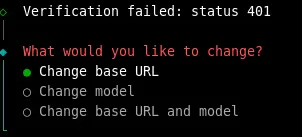

验证API接口。如果输入的API信息不正确,会收到如下图所示错误提示:

此时,可以选择修改API URL、模型或两者。

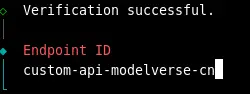

验证成功,选择节点(国内):

设置模型别名(方便在聊天窗口中使用 /model 指令切换):

配置成功,OpenClaw会自动将优云智算大模型设置为主模型。

添加更多模型

编辑配置文件:

nano ~/.openclaw/openclaw.json

配置内容如下:

{

"models": {

"mode": "merge",

"providers": {

"custom-api-modelverse-cn": {

"baseUrl": "https://api.modelverse.cn/v1",

"apiKey": "优云智算API Key",

"api": "openai-completions",

"models": [

{

"id": "glm-5-turbo",

"name": "glm-5-turbo",

"reasoning": false,

"contextWindow": 200000,

"maxTokens": 8192,

"cost": {

"input": 0.000005,

"output": 0.000022,

"cacheRead": 0,

"cacheWrite": 0

}

},

{

"id": "MiniMax-M2.7",

"name": "MiniMax-M2.7",

"reasoning": false,

"contextWindow": 200000,

"maxTokens": 8192,

"cost": {

"input": 0.0000021,

"output": 0.0000084,

"cacheRead": 0,

"cacheWrite": 0

}

},

{

"id": "moonshotai/kimi-k2.5",

"name": "moonshotai/kimi-k2.5",

"reasoning": false,

"contextWindow": 256000,

"maxTokens": 8192,

"cost": {

"input": 0.000004,

"output": 0.000021,

"cacheRead": 0,

"cacheWrite": 0

}

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "custom-api-modelverse-cn/glm-5-turbo",

"fallbacks": [

"custom-api-modelverse-cn/MiniMax-M2.7",

"custom-api-modelverse-cn/moonshotai/kimi-k2.5"

]

},

"models": {

"custom-api-modelverse-cn/glm-5-turbo": {

"alias": "glm"

},

"custom-api-modelverse-cn/MiniMax-M2.7": {

"alias": "minimax"

},

"custom-api-modelverse-cn/moonshotai/kimi-k2.5": {

"alias": "kimi"

}

}

}

}

}

重启网关:

openclaw gateway restart